На что нужно обратить внимание при выборе видеокарты

Как выбрать видеокарту для компьютера: практические рекомендации

Рассказываем, как правильно подобрать видеокарту, чтобы ее возможностей хватило с запасом, при этом не пришлось переплачивать.

Для многих пользователей видеокарта является ключевым компонентом всего компьютера. И хоть мы считаем, что она стоит в одном ряду с процессором, отрицать ее огромное влияние на общую производительность ПК глупо. Поэтому следует внимательно изучить вопрос, прежде чем отправляться в магазин за покупкой. Тем более что современные цены вряд ли позволят вам обновлять видеокарту слишком часто.

При выборе видеокарты стоит учитывать огромное число факторов. Это и характеристики вашего монитора, и размеры корпуса компьютера, и набор тайтлов, в которые вы будете играть. Ну и, конечно, видеокарта должна быть такого же или более высокого класса, что и вся система в целом. К примеру, вам вряд ли стоит покупать Nvidia GeForce RTX 3090 в систему с блоком питания на 450 Вт и процессором Intel Core i3.

Предназначение

Для чего нужна видеокарта? Пожалуй, это ключевой вопрос, на который следует ответить в первую очередь. В зависимости от типа компьютера, комплектующие в него подбираются по соответствующим параметрам. Нет никакого смысла ставить топовую модель в офисный компьютер. И, наоборот, дешевый экземпляр в ПК, на который потрачено немало денег

С офисными задачами справится абсолютно любая видеокарта. Ведь её главная задача лишь в отрисовке интерфейса операционной системы. С игровыми ПК всё несколько сложнее. Иногда нужно немного подкопить, чтобы урвать лакомый кусочек. А иногда можно сэкономить, ведь часто незначительный прирост производительности не стоит потраченных денег.

Nvidia или AMD?

На рынке есть сотни моделей видеокарт и десятки производителей, но лишь два из них выпускают собственные графические процессоры — AMD и Nvidia. И хотя уже скоро к ним присоединится Intel с ее новыми GPU Xe, рассматривать эту компании в качестве одного из ведущих игроков рынка видеокарт пока преждевременно.

Чьи видеокарты лучше? Однозначного ответа на этот вопрос попросту нет. С одной стороны, новейшие видеокарты AMD на GPU Big Navi уже вполне могут на равных конкурировать с моделям Nvidia и порой заметно дешевле последних. Но в арсенале у Nvidia имеется несколько технологий, которые легко могут перевесить разницу в их цене.

Если быть точным, мы говорим о двух ключевых технологиях. Одна из них — это технология трассировки лучей, незаменимая, когда нужно показать естественную игру света и тени. Вторая технология, DLSS, уменьшает разрешение картинки без ощутимой потери в качестве для повышения производительности и увеличения частоты кадров. Но при всех их достоинствах обе технологии используются лишь в ограниченном числе игр, а у AMD уже имеются их аналоги. Они пока выглядят слишком сырыми и отстают от Nvidia, как минимум, на одно поколение, но то, что AMD планирует активно заняться их развитием, не вызывает никаких сомнений.

Как много вы готовы потратить?

Стоимость видеокарт сильно отличается. На рынке можно найти графические ускорители и за 7, и за почти 300 тысяч рублей. Конечно, чем дороже видеокарта, тем она окажется мощнее. Но сейчас их стоимость слишком завышена, и чем более производительную видеокарту вы хотите купить, тем больше будет переплата по сравнению с рекомендованной розничной ценой.

Для того чтобы понять весь масштаб бедствия, достаточно вспомнить, что лучшая на сегодняшний день игровая видеокарта GeForce RTX 3080 Ti с рекомендованной ценой 116 900 рублей продается в России за 180-240 тысяч рублей. Другими словами, переплата может достигать 123 000 рублей.

Поэтому, даже если у вас есть деньги на топовую видеокарту, мы рекомендуем покупать ее только при острой необходимости. В противном случае советуем обратить внимание на более доступные решения или подождать изменения цен на рынке. К этому, кстати, есть все предпосылки. В последнее время Nvidia предпринимает отчаянные шаги по ограничению производительности майнинга в игровых видеокартах, а Intel стремится закрепиться на рынке видеокарт и в ближайшем будущем представит несколько интересных дискретных ускорителей на собственных GPU Intel Xe.

Референсные или кастомные?

Как мы и писали в самом начале, на рынке присутствует множество производителей видеокарт, но большинство из них просто использует разработки Nvidia и AMD. Эталонные образцы видеокарт могут отличаться от кастомных иной конфигурацией системы охлаждения, наличием заводского разгона и другими менее важными факторами.

Выбираем видеокарту для игрового компьютера: как сравнивать, на что смотреть

На какие характеристики обращать внимание и какие особенности учитывать? Рассмотрели всё

Видеокарты различаются сериями видеочипов, в каждой серии есть по три-пять графических процессоров. На базе этих процессоров выпускают десятки версий видеокарт — с разным охлаждением, количеством видеопамяти и разгоном. Поможем разобраться в этом хаосе.

AMD или Nvidia?

Принципиальной разницы между производителями нет. До конца 2020 года видеокарты Nvidia выдавали более реалистичную графику благодаря технологии трассировки лучей, но сейчас она есть и у AMD.

В продаже не найти заводские версии видеокарт от AMD и Nvidia. Вы покупаете версии от Gigabyte, MSI, Asus, Palit и других. На одном и том же видеочипе от AMD или Nvidia компании выпускают несколько модификаций, которые отличаются тактовой частотой, количеством памяти и системой охлаждения. И всё это влияет на цену.

Вот как прочитать название видеокарты.

С чего начать?

Очевидно — с бюджета. Решите, сколько денег вы готовы потратить на видеокарту. Но не спешите брать самую дорогую.

Например, Radeon RX 6800 при сравнимой производительности в середине 2021 года стоит на 30% дороже GeForce RTX 3070, ее конкурента от Nvidia. Чтобы не ошибиться с выбором, оцените производительность подходящих по цене видеокарт, мы расскажем об этом далее.

Выбираем видеочип

Мощность видеокарты зависит не только от видеочипа, но и от огромного количества других технических характеристик: частоты графического процессора, объема видеопамяти, разрядности шины, числа универсальных вычислительных процессоров и так далее. Но это то, с чего стоит начать.

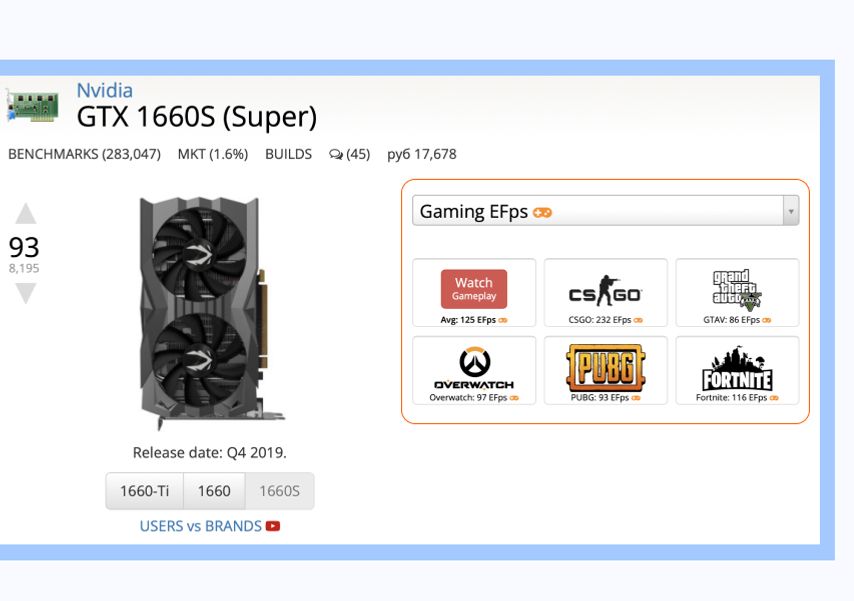

Например, вашего бюджета хватит на GTX 1660 Super или RTX 2060. При беглом сравнении видно, что частота графического процессора у первой — 1530 МГц, а у второй — 1365 МГц. Получается, новая RTX менее производительная, чем GTX? Конечно нет! В ней более совершенная архитектура: больше графических CUDA-ядер, быстрее память.

В первой отражается пользовательский рейтинг, во второй — среднее значение в тестах на производительность. Чем значения выше, тем более мощная видеокарта.

Чтобы понять, каких результатов ожидать в играх, нажмите на название видеокарты и посмотрите замеры средней частоты кадров (количество FPS). Идеальной считается частота от 60 кадров в секунду и выше.

Производительность в играх зависит не только от видеокарты, но и от процессора, поэтому сравнивать видеокарты лучше в паре с ним. На том же UserBenchmark при клике на значок игры можно увидеть процессор, на котором она тестировалась.

Те же действия проделайте с RTX 2060. Как только решите, какой чип вам больше подходит, переходите к выбору модификации.

Стоит ли переплачивать за частоту видеопроцессора?

Версия от Palit стоит на 15 000 рублей дешевле, но и частота графического процессора у нее — 1320 МГц, а у Asus — 1882 МГц. Выбрав более разогнанную модель, в играх вы получите на 5–10% больше кадров в секунду.

Объем видеопамяти

Количество видеопамяти в разных модификациях тоже может отличаться. Например, RX 570 встречаются как с 4 ГБ, так и 8 ГБ видеопамяти. У GTX 1060 бывает 3 ГБ или 6 ГБ видеопамяти. Если разница в цене составляет 500–1000 рублей, лучше доплатить.

Если разница в цене больше, выбирайте объем, отталкиваясь от своих потребностей в игре. Вот на какие параметры стоит ориентироваться (для ААА-проектов):

Трассировка и сглаживание: нужны или нет?

Технология трассировки лучей. Создана для того, чтобы объекты в игре выглядели максимально реалистично. Чтобы лучи света, блики и тени выглядели, как в жизни. Nvidia впервые представила эту технологию вместе с линейкой видеокарт GeForce RTX, а позже выпустила драйвер и для более ранних карт.

AMD поддержку трассировки реализовали только в Radeon RX 6000-й серии, которая начала появляться в продаже в конце 2020 года. Таких видеокарт у компании меньше, чем у Nvidia.

Учтите, что трассировка лучей снижает производительность видеокарты в играх. Вы получите более реалистичную графику, но с меньшей частотой кадров (FPS). Для топовых видеокарт это не проблема, частота кадров остается приемлемой. Но с бюджетными решениями, чтобы сохранить 60 FPS, придется снижать настройки графики.

Технологии сглаживания. Позволяют улучшить качество картинки. Контуры объектов и персонажей выглядят ровными, пропадает эффект лесенки, во время движения нет ряби.

Раньше для достижения такого эффекта в видеокартах использовались технологии TXAA, FXAA и MSAA. Но они снижали производительность: частота кадров падала до 30–40 FPS.

Современные разработки — DLSS у Nvidia и FidelityFX Super Resolution у AMD — наоборот, дают прирост производительности от 5% до 20%. То есть вместо 50 FPS можно получить стабильные 60 FPS, а вместо 90 FPS — 100 FPS. Это позволяет не снижать настройки графики при повышении разрешения и играть на мониторе с частотой обновления 80, 90 или даже 120 Гц и выше.

Читайте : какой игровой монитор купить: Acer Nitro или Asus Rog Swift?

Как убедиться, что видеокарта подходит ПК?

Еще один важный шаг — проверка на совместимость. Если не учесть размер и другие особенности, видеокарта может не поместиться в корпус или вовсе не заработает.

Длина и ширина

Убедитесь, что видеокарта поместится в корпус вашего ПК. В первую очередь посмотрите, какую максимальную длину видеокарты он поддерживает. Это указано в характеристиках корпуса.

Но учтите, что видеокарте могут мешать другие элементы: радиатор системы водяного охлаждения и вентиляторы. Это происходит там, где установка вентиляторов и СВО происходит во внутреннюю часть корпуса.

Например, во Fractal Design Define S допускается установка видеокарт длиной до 450 мм, а при установке спереди вентиляторов — до 425 мм. Эту информацию можно найти на сайте производителя. А если вы решите установить еще и радиатор СВО, то от 425 мм нужно будет отнять толщину радиатора.

Еще один важный параметр — ширина. Видеокарты с массивной системой охлаждения могут занимать несколько слотов расширения корпуса. Например, Palit GeForce RTX 3070 GamingPro занимает целых три слота, через которые на заднюю стенку компьютера выводятся разъемы для подключения мониторов. Широкие видеокарты часто блокируют установку Wi-Fi-плат, звуковых карт в соседние слоты PCI-Express, которые находятся выше или ниже слота видеокарты. Как проверить?

Посмотрите, как расположены слоты на плате, и измерьте расстояние между ними. Например, в Asus ROG STRIX B450-F Gaming II слоты PCI-Express далеко один от другого, так что видеокарта Palit, которую мы недавно упоминали, их не перекроет.

Не забудьте про питание

В технических характеристиках видеокарты указывается минимальная мощность блока питания (БП), с которым она будет стабильно работать.

В названии блока пишут суммарную мощность для всех линий питания, куда входят жесткие диски и другое оборудование. Выделяемая процессору и видеокарте мощность может быть значительно меньше. Значение можно узнать из таблицы на корпусе БП, в графе 12 В.

Обратите внимание и на разъемы питания. В описании видеокарты посмотрите, сколько блоков по 6 или 8-pin для нее требуется. И сравните эти значения с характеристиками БП (вам нужна графа «Питание видеокарты»). Там должно быть столько же блоков по 6 или 8-pin или больше, но никак не меньше, чем нужно видеокарте. Подробнее о том, как рассчитать мощность БП, смотрите в видео:

Какой у вас экспресс?

Когда говорят о разъеме подключения на материнской плате, обычно упоминают версию PCI-Express (2.0, 3.0 и с недавнего времени — 4.0). Точное количество портов и их тип указаны в графе «Слоты расширения» в характеристиках материнской платы. Как правило, порт с самой последней версией предназначен для видеокарты. У видеокарт версия PCI-е указана в характеристиках в пункте «Интерфейс».

Если у вас установлена старая материнская плата, поддерживающая формат 2.0, а видеокарта поддерживает 3.0, ничего страшного. Видеокарта будет работать с пропускной способностью младшей версии PCI-Express, хотя и медленнее. В идеале стоит выбрать видеокарту с разъемом той же версии, которую поддерживает материнская плата. Или с более высокой, если собираетесь менять плату.

А что с монитором?

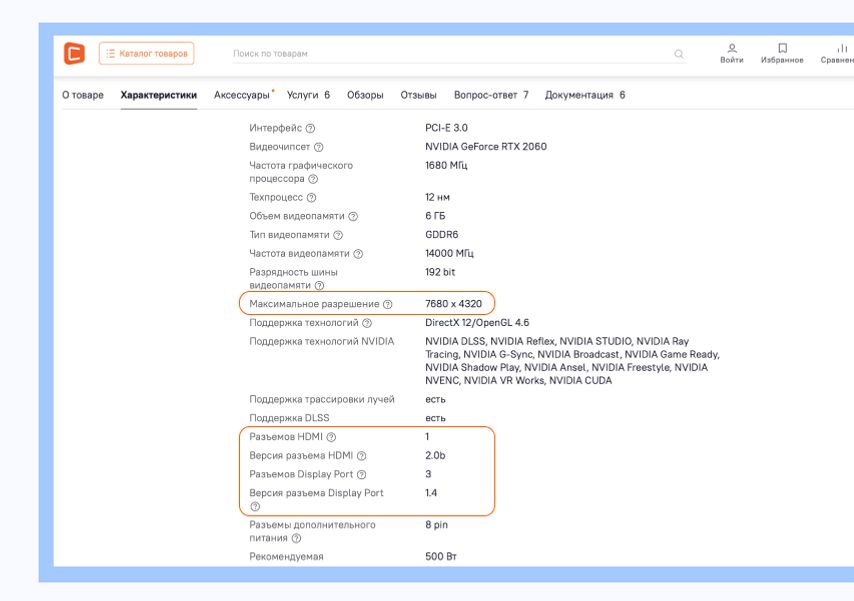

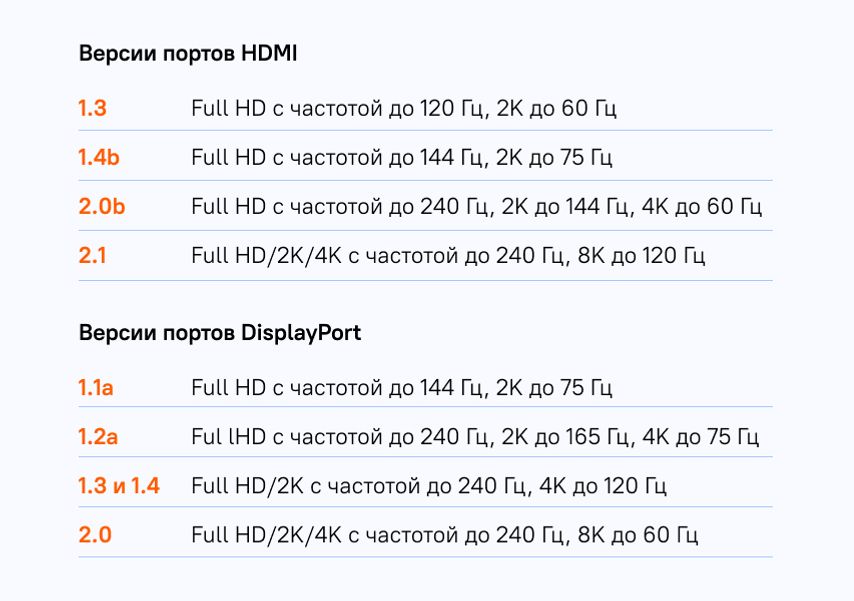

Видеокарты поддерживают разные разрешения экрана и разное количество мониторов. А еще от видеокарты зависит максимальная частота кадров, которую отобразит монитор за одну секунду (частота обновления, измеряется в герцах (Гц)).

Также у видеокарты есть один порт HDMI версии 2.0b и три порта DisplayPort версии 1.4. То есть порт HDMI поддерживает Full HD с частотой до 240 Гц, 2K до 144 Гц, 4K до 60 Гц, а порты DisplayPort — Full HD/2K с частотой до 240 Гц и 4K с частотой до 120 Гц.

Чтобы понять, какие разъемы вам нужны, посмотрите на характеристики монитора. Если монитор Full HD с частотой обновления до 240 Гц, хватит HDMI 2.0b или DisplayPort 1.2a. Для монитора с 2К-разрешением и частотой 240 Гц понадобится HDMI 2.1 или DisplayPort 1.3.

При подключении посмотрите в инструкции к монитору, какая частота и какое разрешение поддерживаются на каждом из его портов. Бывает так, что максимальное качество доступно только на DisplayPort или одном из нескольких HDMI. Именно к ним и нужно подключить видеокарту.

7 распространенных ошибок при выборе видеокарты

Содержание

Содержание

Естественное желание каждого покупателя — получить максимум отдачи от приобретенного товара. То есть — выбрать из конкурирующих решений наиболее качественное, функциональное, либо просто в большей степени соответствующее вкусам нового владельца.

Это стремление логично и не нуждается в каких-либо пояснениях. Но парадокс заключается в том, что чем более технологичным (а следовательно — более дорогостоящим и менее регулярно приобретаемым) является товар — тем в меньшей степени покупатели склонны оценивать его первостепенные характеристики, обращая внимание на менее значимые моменты или вовсе сводя покупку в область эмоций.

Комплектующие для компьютера — в частности, видеокарты, — отнюдь не исключение из этого правила. Ошибок при их выборе совершается немало, и в данной статье мы постараемся осветить основные из них.

Нужно ли смотреть на объем памяти?

К сожалению, фразы вроде «фу, у этой карты 4 гигабайта, на ней только в пасьянс играть!», «у этой видеокарты всего 6 гигабайт памяти, я лучше возьму вот эту — у ней сразу 8!» или бессмертное «у меня карта на 8 гигабайт, эта игрушка на ультра летает!» буквально заполоняют компьютерные форумы, карточки товаров в интернет-магазинах, социальные сети и прочие смежные ресурсы.

Принято считать, что чем больше у карты набортной памяти — тем выше ее производительность, а прочие характеристики либо второстепенны, либо вовсе не имеют значения.

На самом деле, конечно же, это не так.

Набортная память видеокарты сама по себе не влияет на производительность — это всего лишь хранилище для используемых видеокартой данных. И фраза о преимуществах видеокарты с 8 гигабайтами набортной памяти над картой с 6 гигабайтами звучит буквально как «автомобиль с багажником на 500 литров быстрее, экономичнее, комфортнее и лучше в управлении, чем автомобиль с багажником на 350 литров».

Иначе говоря — представляет собой полный абсурд.

Во-первых, производительность видеокарты определяется в первую очередь характеристиками ее ГПУ: количеством исполнительных блоков, архитектурными особенностями, рабочими частотами. Говоря проще — при одинаковом объеме набортной памяти (6 гигабайт), бюджетная GeForce GTX 1660 никогда не будет равна GeForce RTX 2060, стоящей на пару ступеней выше в линейке продуктов.

Но в качестве наглядного примера мы рассмотрим другие карты аналогичных классов:

Встроенный бенчмарк игры Assassin’s Creed: Odyssey запущен в разрешении FullHD с настройками графики, соответствующими штатному профилю «Высокое качество». Конфигурация ПК полностью идентична, за исключением самих видеокарт.

Слева — Radeon RX 5600 XT в исполнении Sapphire с типичными для этой модели 6 гигабайтами набортной памяти.

Справа — Radeon RX 5500 XT в исполнении MSI в версии с 8 гигабайтами набортной памяти.

Частоты видеокарт, в отличие от ЦПУ и оперативной памяти, не приведены к общему знаменателю, но в данном случае этого и не требуется — разница и без того очевидна.

В первом случае по итогу тестовой сцены мы получаем 74 кадра по среднему фпс, 62 кадра по минимальному и просадки до 59 кадров в 1% редких событиий. Во втором — 60, 50 и 48 кадров соответственно.

Так какая карта оказывается быстрее — с 6 или с 8 гигабайтами памяти на борту?

Во-вторых, как уже говорилось выше, память видеокарты — это хранилище данных. А размеры любого хранилища рассчитываются исходя из объема содержимого, которое в него планируется поместить. В случае видеокарты — исходя из объема памяти, который реально задействуют игры. А требования игр — отнюдь не константа, они находятся в прямой зависимости от разрешения экрана и настроек графики. Говоря проще — одна и та же игра на высоких и на средних настройках будет обладать совершенно разными аппетитами.

Рассмотрим следующий пример:

Red Dead Redemption 2, одна из самых требовательных игр последних лет. Здесь используется одна и та же видеокарта — Radeon RX 5500 XT 8gb в исполнении MSI.

Слева используются высокие настройки графики, справа — средние. Разрешение в обоих случаях — FullHD.

Мониторинг позволяет увидеть, что на высоких настройках используется до 6900 мегабайт набортной памяти, так что 8 гигабайт, чтобы поиграть в RDR 2 на высоких, — вполне реальная необходимость. На средних же потребление памяти снижается до 5500 мегабайт — так что карт с 6 гигабайтами памяти на борту для этих настроек тоже хватит. Однако есть одно большое «НО».

C RX 5500 XT, пусть у него и есть необходимые 8 гигабайт памяти, на высоких настройках мы получаем 45 кадров по среднему фпс, 38 — по минимальному и просадки до 36 кадров в 1%.

Бесспорно, многие назовут этот режим играбельным, но, если подходить к вопросу объективно — для по-настоящему комфортного геймплея настройки следует понижать.

На средних же настройках с тем же RX 5500 XT мы получаем 61, 52 и 49 кадров соответственно. Эти показатели как раз и можно назвать комфортными.

Вывод из примеров выше будет следующим:

Объем памяти — важный параметр, но учитывать его необходимо не в отдельности, а только и исключительно в комплексе всех прочих характеристик видеокарты.

Да, в реалиях сегодняшнего дня, даже если вы выбираете видеокарту для игр в самом ходовом разрешении FullHD, следует ориентироваться на карты с объемом памяти в 6 и 8 гигабайт, НО — только в том случае, если выбранная вами карта способна обеспечить комфортный фпс в интересующей вас игре на тех настройках, где эти 6 или 8 гигабайт реально потребуются.

Если же вас интересуют сетевые игры со сравнительно простой графикой, если вы планируете играть в игры не последних лет выпуска, либо если выбирается очень бюджетное решение, способное тянуть тяжелые новинки только на средневысоких настройках — нет смысла гнаться за большим объемом памяти. Во всех этих случаях либо реальное потребление памяти в игре будет сравнительно низким, либо производительность упрется в возможности ГПУ, а не памяти карты.

Так ли важны характеристики разрядности шины памяти или частоты в отдельности?

Этот и последующий пример можно охарактеризовать так же, как и вопрос с объемом памяти видеокарты. А именно — как стремление не рассматривать характеристики продукта не в комплексе, а максимально упростить их, сведя лишь к одному параметру.

Тезисы, разумеется, здесь звучат максимально похоже: «как можно выпускать в 2020 году обрезок со 128-битной шиной?», «да тут всего 192 бита, а еще в прошлом поколении было 256 — я лучше возьму старую карту, она явно быстрее!» и так далее.

Во-первых, помимо ширины шины памяти, есть такие понятия как рабочие частоты и тип памяти. Итоговую пропускную способность подсистемы памяти эти характеристики формируют не по отдельности, а в комплексе. И современные чипы GDDR6 даже на 128-битной шине могут обеспечить те же, или близкие значения к показателям GDDR5 на 256-битной шине.

224 гигабита в секунду против 256 — совсем не та разница, которую следовало бы ожидать, говоря о вдвое «снизившейся» ширине шины памяти.

Однако, во-вторых, сводя все к одному параметру, пусть даже он является комплексным, мы совершаем ровно ту же ошибку, что и рядовые покупатели. Пропускная способность интерфейса описывает лишь максимальный объем данных, который теоретически можно передать за единицу времени.

Ключевое слово здесь — теоретически. На практике же значение имеет архитектура ГПУ и предполагаемые ей алгоритмы сжатия данных.

Рассмотрим очередной практический пример:

Metro: Exodus, встроенный бенчмарк. Разрешение — FullHD, настройки графики — высокие, тесселяция включена, технологии Hairworks и Advanced PhysX — выключены.

Слева — Radeon RX Vega 56, использующий скоростную память типа HBM2 на 2048-битной шине. Справа –GeForce RTX 2060, с типичной для нее GDDR6 на 192-битной шине.

Казалось бы, при таких вводных данных разница в пользу первого решения должна быть очевидной, но на самом деле с Vega56 по итогу теста мы получаем 67 кадров по среднему фпс и 35 — по минимальному, а с RTX 2060 — 66 и 35 кадров соответственно.

Видеокарта — это крайне сложное и технологичное устройство, буквально «компьютер в компьютере», оснащенный собственным процессором, собственным объемом памяти и интерфейсами для передачи данных. И, как у любого компьютера, у видеокарты есть своя архитектура и свой софт, использующий ее преимущества. Поэтому любой параметр, касающийся характеристик видеокарты, нельзя рассматривать в отдельности, а уж тем более — делать какие-то выводы, основываясь исключительно на одном этом параметре.

Впрочем, не совсем так.

Есть один параметр, который действительно может определять и описывать абсолютно все, и согласно которому можно расставлять видеокарты по умозрительной лестнице предпочтений. И это, как легко догадаться — производительность карты в реальных играх.

Корректно ли сопоставлять количество функциональных блоков чипа при сравнении видеокарт разных поколений и от разных производителей?

Характеристики графического процессора, как и центрального процессора компьютера, определяются в первую очередь его частотой и количеством исполнительных блоков — т.е. универсальных шейдерных процессоров, текстурных блоков и блоков растровых операций.

И, как в случае центральных процессоров 6 ядер на частоте в 4000 МГц будут быстрее 4-х ядер на 3400 МГц, так и в случае ГПУ — чем выше частота и больше блоков, тем выше производительность. Однако, тут тоже есть свое большое «НО».

Как и ЦПУ, графические ядра видеокарт можно сравнивать «по цифрам» только в рамках одного поколения и одной архитектуры. Например, Radeon RX 580 с его 2304 процессорами, 144 TMU и 32 блоками ROP будет всегда быстрее RadeonRX 570, характеристики которого можно записать по формуле 2048/128/32.

Но вот когда заходит речь о картах разных поколений или разных производителей — стоит всегда иметь ввиду, что первостепенное значение имеет архитектура, а не частота или количество блоков. Так, карта нового поколения может иметь 2300 универсальных процессоров, а карта предыдущего поколения — все 3600, но в реальных играх полуторакратной разницы вы не увидите:

World of Tanks — правда, уже довольно старой на сегодня версии 1.5.1.3, актуальной на момент проведения тестов. FullHD, настройки графики — ультра.

Слева — Radeon RX 5700, располагающий 2304 универсальными процессорами, 144 текстурными блоками и 64 блоками ROP.

Справа — Radeon RX Vega 56, его прямой предшественник. 3584, 224 и 64 блока соответственно.

Разумеется, частота ГПУ у новинки немного выше, но 240–250 МГц не могли бы обеспечить столь заметный отрыв в производительности при такой разнице в количестве исполнительных блоков. А вот новая архитектура — еще как может!

Оценивать по количественным параметрам и сравнивать между собой можно только видеокарты одного поколения. Если же говорить о картах на принципиально разной архитектуре — можно прийти к условной ситуации, в которой есть некий чип с 1000 универсальных процессоров и его более старый аналог, у которого их 1500.

Казалось бы, второй вариант будет гарантированно быстрее, но вот незадача: 1500 процессоров на старой архитектуре могут выполнять лишь 2 инструкции за каждый такт, а каждый из 1000 новых процессоров — все 4 инструкции.

Пример, разумеется, полностью умозрительный, и аллюзий на реальные графические чипы не предполагающий. Но суть он передает верно.

Как не ошибиться при расчете питания?

Как и любые другие комплектующие, для своей работы видеокарты требуют определенное количество электроэнергии. Соответственно, встает вопрос о том, с помощью чего запитать видеокарту, планируемую к покупке. И в этом случае могут иметь место две крайности:

В обоих этих случаях пользователь оказывается в проигрыше. Поэтому, чтобы не потратить лишних денег и не получить заведомо нестабильную систему, нужно обязательно помнить следующее:

— Блок питания выбирается не «под видеокарту», а под всю систему в целом.

Видеокарта — это только один из составляющих элементов. Помимо нее, в системном блоке также проживают центральный процессор, жесткие диски, оперативная память, материнская плата и, возможно, какие-то платы расширения вроде звуковой карты. Все они в работе также потребляют какое-то количество ватт, и их также нужно учитывать при выборе блока питания.

— Указанная на вашем блоке мощность не обязательно есть в нем фактически.

Качество блоков питания — довольно скользкая тема, и касаться ее в рамках данной статьи мы не будем. Но все же — напомним, что условный блок на 500 ватт, выпущенный в 2010 году и активно эксплуатировавшийся до сегодняшних дней, и современный блок на те же 500 ватт, в реальных замерах выдадут совершено разную мощность. Поэтому, при расчетах совместимости оперировать нужно не цифрами с этикетки, а реальными моделями блоков питания и их фактическим состоянием.

— Фактическое энергопотребление видеокарты и рекомендуемая мощность блока питания — разные вещи.

В характеристиках видеокарт. Указанных на сайтах производителей и в карточках магазинов, можно обнаружить такой параметр, как «рекомендуемая мощность БП». Некоторые часто путают ее с энергопотреблением видеокарты, что и порождает «авторитетные советы» приобретать блоки мощностью 800 ватт к бюджетным видеокартам вроде GTX 1650 — GTX 1660 — RX 5500 XT.

На самом деле, производители видеокарт как раз прекрасно знают предыдущие два тезиса. И рекомендуемая ими мощность — это как раз мощность для ВСЕЙ системы с установленной в нее видеокартой. Более того — мощность эта намеренно завышена, поскольку тем самым производитель защищает себя от претензий со стороны владельцев низкокачественных БП.

Так как определить реальное энергопотребление интересующей вас видеокарты?

Проще всего — прочесть обзор на нее от авторитетного источника. Да, нередко в обзорах указывается энергопотребление всей системы, а не отдельно видеокарты — но так получается даже более наглядно. Ведь, если тестовая система на условном Core i9-9900K в разгоне показывает пиковое энергопотребление на уровне 580 ватт, то ваш компьютер с опять же, условным Core i5-9400F есть будет очевидно меньше.

Впрочем, если в вас вдруг проснется азарт исследователя, можно пойти и более сложным путем.

Одной из основных характеристик современных видеокарт является лимит энергопотребления. Это программное ограничение (аппаратным может являться, разве что, конфигурация разъемов дополнительного питания), по достижении которого видеокарта начинает сбрасывать частоты и понижать напряжения, чтобы остаться в обозначенных пределах.

К примеру, если видеокарта имеет лимит на 130 ватт, то без разгона и ручного поднятия лимита больше есть она не будет — как бы различные «интернет-знатоки» ни советовали вам покупать для нее блоки мощностью 800 ватт минимум.

А поскольку ограничение это программное — узнать его можно напрямую из биос видеокарты. Для этого нужно либо скачать файл и открыть его диагностической утилитой, либо обратиться, например, к базе данных портала Techpowerup.

Слева — отчет утилиты MorePowerTool о лимитах видеокарты Sapphire Radeon RX 5600 XT Pulse. Лимит энергопотребления для ГПУ составляет 160 ватт. Остальные элементы в данном случае не учитываются, однако их потребление существенно ниже чем у ГПУ, для простоты можно округлить до 30–40 ватт.

Справа — информация о видеокарте Gigabyte GeForce RTX 2060 Windforce OC из базы данных Techpowerup. Здесь уже приводится общий лимит энергопотребления, и он составляет 200 ватт.

Разумеется, лимит энергопотребления — это именно пиковое значение, в реальных задачах видеокарта не всегда будет потреблять максимальное количество электроэнергии, но при расчетах мощности БП следует учитывать именно возможный максимум.

И, конечно же, надо помнить, что при разгоне видеокарты лимит энергопотребления вам придется повышать — а, следовательно, нужно закладывать некоторый запас сверх штатного значения. Опять же, здесь поможет изучение характеристик биос карты — так, на примере выше видно, что для конкретно этой версии RTX 2060 штатными средствами лимит можно поднять лишь на 18%.

При расчетах мощности блока питания для вашей системы следует учитывать всего два фактора: реальное энергопотребление ваших комплектующих и не менее реальные характеристики вашего БП. И с первым, и со вторым поможет вдумчивое изучение обзоров.

В крайнем случае — можно просто сравнить энергопотребление видеокарты, которую вы планируете приобрести, с той, которая стоит в вашем системном блоке сейчас. Хотя современные микросхемы и более сложны, их аппетиты вполне могут оказаться ниже, чем у предшественников.

Важно ли подбирать видеокарту под конкретный процессор?

Сегодня вопросы вроде «а подойдет ли эта видеокарта к моему процессору?» по своему количеству и частоте задавания уже уверенно обходят вопросы совместимости с блоками питания. Можно предположить, что здесь действительно есть какие-то тонкости, однако на самом деле это не так.

Если вопрос касается именно совместимости системы с видеокартой — то модель и семейство установленного процессора ее не определяют. Более того: как правило, если видеокарта использует интерфейс PCI-e и поддерживается в установленной на компьютере ОС — это все, что от нее требуется.

Иначе говоря, если вы собираете ПК на новой платформе, но бюджет не позволяет сразу приобрести видеокарту актуального поколения — можно использовать карту, оставшуюся от предыдущей системы, или бюджетное решение старого поколения, купленное на вторичном рынке.

И обратное тоже верно: в компьютеры, собранные на не самых новых платформах, можно устанавливать видеокарты актуальных поколений, если вам не хватает производительности графической части, или бюджет позволяет заменить только видеокарту.

Встроенный бенчмарк игры Assassin’s Creed: Odyssey утверждает, что тестовая система объединяет процессор Intel Corei7-4930K, выпущенный в 2013 году для уже давно устаревшей платформы LGA 2011, и видеокарту GeForce RTX 2080 Ti, выпущенную в конце 2018 года, и актуальную до сих пор.

Причем, разумеется, пример выше — далеко не единственный. При желании в Интернете можно найти множество сборок даже на более старых процессорах — к примеру, Core i5/i7 Sandy Bridge и FX Piledriver, объединенных с современными видеокартами. И не только в виде статичных картинок, но и видеороликов, посвященных сборке и тестированию получившихся систем.

Безусловно, бывают случаи индивидуальной несовместимости, когда видеокарта напрочь отказывается инициализироваться и работать, хотя сама она гарантированно исправна. Но, во-первых, в современных реалиях это большая редкость, а во-вторых, вопросы в данном случае следует адресовать к материнской плате, а не к процессору.

Однако речь может идти не просто о совместимости и возможности эксплуатировать систему с новой видеокартой, но и об итоговой производительности получившегося компьютера в играх. И здесь все уже отнюдь не так просто.

Мифы о «раскрывашках»

«Раскрывашки», наиболее активно нервировавшие интернет-сообщество в период с 2014 по 2018 год, сегодня уже являются в большей степени забавным мемом и поводом для шуток, нежели серьезной проблемой. Однако и сейчас изредка проскакивают вопросы вроде «а раскроИт ли?», в которых потенциальные владельцы новых видеокарт желают знать, насколько быстрой окажется их система после апгрейда.

Согласно популярному заблуждению, к новым и быстрым видеокартам обязательно приобретать процессоры новых поколений. Причем чем выше будет индекс модели — тем лучше для производительности. Хотя реальные системные требования игр, как и соотношение производительности уже имеющегося у пользователя процессора с рекомендуемой ему моделью значения здесь никакого не имеют.

Если же пользователь не желает приобретать новый процессор (разумеется, вместе с полагающейся к нему материнской платой и в некоторых случаях — оперативной памятью), ему заявляется, что и в апгрейде видеокарты нет никакого смысла, ведь работать она будет на уровне младших моделей той же линейки, а то — и вовсе так же, как и старая видеокарта.

Разумеется, все это — крайности, доведенные до абсурда. И ключевая задача любой «раскрывашки» — не помочь, а именно убедить пользователя потратить деньги на новое железо помимо видеокарты. Чего ему, возможно, вовсе и не надо делать.

В реальности, конечно, процессор оказывает существенное влияние на производительность системы. Но, во-первых, не он один, а во-вторых — влияние это не во всех играх одинаково, и уж точно не определяется индексом модели процессора.

Рассмотрим несколько примеров.

Total War: Three Kingdoms. Игра, довольно требовательная к ресурсам центрального процессора и к тому же — использующая преимущества многопотока.

Слева — Intel Core i9-9900KF. Справа — Intel Core i7-9700KF. Оба процессора разогнаны до 5000 МГц, частота кольцевой шины поднята до 4700 МГц, видеокарта RTX 2080 Ti работает в штатном для нее режиме, все прочие условия идентичны.

При этом, в случае с Core i7-9700KF фпс в бенчмарке оказывается… выше!

Да, это исключительно частный случай, связанный с тем, что технология Hyper Threading, отличающая Core i9 от Core i7, в играх далеко не всегда работает корректно, и производительность старшей (. ) модели ЦПУ при прочих одинаковых условиях оказывается ниже, чем у младшей.

Встроенный бенчмарк игры WarThunder, являющейся уже диаметрально противоположным примером. Движок игры по сей день активно использует не более 2-х ядер.

Слева — снова Core i9-9900KF, но на сей раз — в номинальном для него режиме. 4700 МГц по всем ядрам за счет технологии MCE, 4300 МГц на кольцевой шине. Справа — уже Core i5-9600KF, разогнанный ровно до тех же параметров. Все прочие характеристики системы идентичны, в качестве видеокарты опять используется RTX 2080 Ti.

Разница в фпс, опять же, в комментариях не нуждается. В данном случае Core i9 в принципе не может иметь никаких преимуществ над Core i5 — игра попросту не использует «лишние» ядра. А технология Hyper Threading здесь опять ведет себя не лучшим образом, что и позволяет Core i5-9600KF выдавать немного больше кадров в секунду.

И это далеко не единственные примеры, категорически не вписывающиеся в картину мира, предлагаемую раскрывашками.

В реальности у каждой игры свои требования к характеристикам центрального процессора. Так, где-то используется максимально доступное количество ядер — и, например, старые процессоры под ту же платформу LGA 2011 могут не только эффективно справляться с игрой, выпущенной на 7 лет позже них самих, но и обеспечивать более комфортный геймплей, чем современные модели под LGA 1151_v2.

Где-то — наоборот, количество ядер не имеет значения, важна только тактовая частота и производительность в однопоточной нагрузке. Какие-то игры в силу особенностей движка в принципе мало зависимы от процессора и более требовательны к видеокарте. Да и сама «зависимость» от характеристик процессора в одной и той же игре может меняться со сменой разрешения экрана и настроек графики: чем они выше — тем выше влияние видеокарты, и менее заметна разница между более и менее быстрыми ЦПУ.

Раскрывашки же эти факты игнорируют и сводят все к одному простому тезису: «более дорогой и новый процессор — лучше». Но для кого именно лучше — обычно умалчивают.

Заключение

Конечно, в данной статье мы рассмотрели лишь часть распространенных ошибок, совершаемых при выборе видеокарт. Если начинать рассматривать отдельные семейства — да что там, даже отдельные ценовые сегменты! — то легенд и мифов можно будет обнаружить великое множество.

Но и эти, и любые другие мифы рождаются там, где нет четкого знания и подтвержденной информации. Выдумка, изложенная максимально просто и понятно, всегда будет более притягательна, чем факты, которые нужно изучать, анализировать и сопоставлять. Однако опираться на выдумки никогда не стоит.

Если вы хотите получить товар, максимально отбивающий свою цену — стоит сперва потрудиться и изучить сведения о нем сразу в нескольких авторитетных источниках, а не следовать первой попавшейся на глаза рекомендации.